Pourquoi développer des applications d’IA sur Scalingo ?

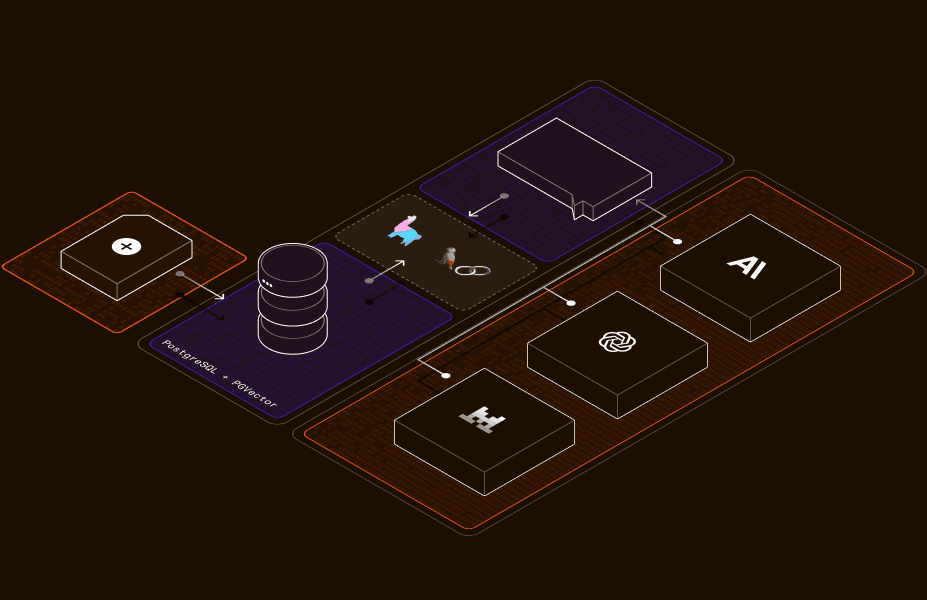

Déployez des applications d’IA avec la recherche vectorielle intégrée

Développez vos applications d’IA en toute confiance, avec zéro infra à gérer.

Déployez des applications d’IA et des serveurs MCP

Faites tourner le backend de vos applications d’IA, de vos endpoints API aux workers en arrière-plan, en passant par les pipelines d’embedding et les serveurs MCP, sur une plateforme PaaS entièrement managée.

Avec stockage vectoriel intégré

Créez des moteurs de recherche sémantique, des systèmes de recommandation et des applications RAG à partir de bases de données managées compatibles avec les requêtes par similarité vectorielle.

Sur une plateforme entièrement managée

Bases de données, scalabilité, supervision et sauvegardes : tout est inclus. Concentrez-vous sur vos fonctionnalités d’IA, pas sur l’infrastructure.

Choisissez parmi nos options de base de données vectorielles

PostgreSQL + pgvector :

Stockage vectoriel entièrement managé

Stockez vos embeddings aux côtés de vos données applicatives pour alimenter la recherche sémantique, les recommandations et les applications RAG.

Recherche par similarité rapide

pgvector prend en charge les index vectoriels approximatifs (par exemple IVFFlat) afin d’exécuter efficacement des requêtes par similarité à grande échelle.

Stockage évolutif

Gérez de grands volumes d’embeddings grâce au moteur de stockage robuste de PostgreSQL et à ses options de montée en charge.

Conformité ACID

Les embeddings bénéficient des garanties transactionnelles (ACID) de PostgreSQL, pour plus de cohérence et de fiabilité.

Données regroupées dans la même base

Conservez vos embeddings et métadonnées dans la même base de données pour simplifier l’architecture et réduire la complexité opérationnelle.

-- Create vector table

CREATE TABLE embeddings (

id SERIAL PRIMARY KEY,

content TEXT,

embedding vector(1536)

);

-- Create HNSW index

CREATE INDEX ON embeddings

USING hnsw (embedding vector_cosine_ops);

-- Similarity search

SELECT content FROM embeddings

ORDER BY embedding <-> $1

LIMIT 10;

// Create k-NN index

PUT /embeddings

{

"mappings": {

"properties": {

"embedding": {

"type": "knn_vector",

"dimension": 1536

}

}

}

}

// Vector similarity search

POST /embeddings/_search

{

"query": {

"knn": {

"embedding": {

"vector": [0.1, 0.2, ...],

"k": 10

}

}

}

}

OpenSearch : recherche vectorielle et analyses

OpenSearch managé pour vos cas d’usage de recherche, de logs et de récupération vectorielle.

Recherche vectorielle k-NN

Stockez et interrogez des vecteurs de haute dimension à l’aide d’index de plus proches voisins.

Recherche rapide

Conçu pour les charges de recherche intensives.

Clusters évolutifs

Déploiements multi-nœuds en haute disponibilité.

Opérations managées

Déploiements multi-nœuds en haute disponibilité.

OpenSearch ML

Modèles d’embedding et pipelines sémantiques.

Ajoutez à OpenSearch des capacités de machine learning pour générer des embeddings et alimenter des workflows de recherche sémantique, directement dans votre cluster.

Déploiement de modèles

Enregistrez et déployez des modèles d’embedding ONNX (par exemple issus de Hugging Face) pour exécuter l’inférence dans OpenSearch.

Pipelines d’ingestion

Générez automatiquement des embeddings lors de l’indexation de vos documents.

Pipelines de recherche

Vectorisez les requêtes utilisateur au moment de la recherche et exécutez des recherches par similarité vectorielle.

Applications de recherche sémantique

Créez des systèmes RAG, des bases de connaissances enrichies par l’IA, des agents IA, des outils MCP et des expériences de recherche multilingue.

// Register embedding model

POST /_plugins/_ml/models/_register

{

"nom": "transformateur-de-sentences,"

"version": "1.0"

"model_format": "ONNX"

}

// Create ingest pipeline

PUT /_ingest/pipeline/embeddings

{

"processors": [{

"text_embedding": {

"model_id": "sentence-transformer",

"field_map": {

"text": "embedding"

}

}

]}

}

Stack compatible

Compatible avec vos outils IA préférés

Une infrastructure agnostique, compatible avec la plupart des stacks IA

Bases de données

PostgreSQL + pgvector

Stockage des embeddings et recherche par similarité vectorielle

OpenSearch + knn + ML

Recherche sémantique et vectorielle

API pour les LLM

OpenAI

Modèles de type GPT-4 et embeddings

Anthropic

Modèles de type Claude 3

Mistral AI

Fournisseur européen de LLM

Cohere

Modèles Command et Embed

Frameworks IA

LangChain

Python et JavaScript

LlamaIndex

Infrastructure de données pour les LLM

Infrastructure de données pour les LLM

Utilisez votre propre stack

Cas d’usage de l’IA vectorielle

Des applications d’IA déjà en production chez nos clients

Cas d’usage

Chatbots RAG

Des assistants IA alimentés par vos données. Répondez à des questions à partir de vos documents et de votre base de connaissances.

Bases de connaissances pour l’IA

Des wikis internes et des FAQ enrichis par le RAG. Le savoir interne de l'entreprise devient accessible via une recherche IA.

Recherche sémantique

Trouvez le bon contenu grâce au sens, pas seulement aux mots-clés. Recherche vectorielle dans vos documents et articles.

Recherche vectorielle

Recherche par similarité sur les embeddings. Identifiez des contenus, produits ou recommandations similaires.

Analyse de documents

Extrayez des informations clés de vos documents et retrouvez rapidement l’information pertinente. Des systèmes de recherche documentaire conçus pour les données d’entreprise.

Assistants IA

Des agents contextualisés pour votre application. Des assistants compatibles MCP, enrichis par le contexte de vos bases de données.

Testez dès maintenant avec nos fonctionnalités IA.